Character.AI( https://www.character.ai )是一款基于大语言模型(LLM)的交互式聊天机器人平台,由前谷歌工程师Noam Shazeer和Daniel De Freitas于2022年9月创立。其核心特色在于通过人格化AI角色满足用户的社交、情感支持和创意需求,与通用型AI工具(如ChatGPT)形成差异化定位。以下从功能、技术、用户群体及安全策略等方面进行系统解读:

1. 核心功能与定位

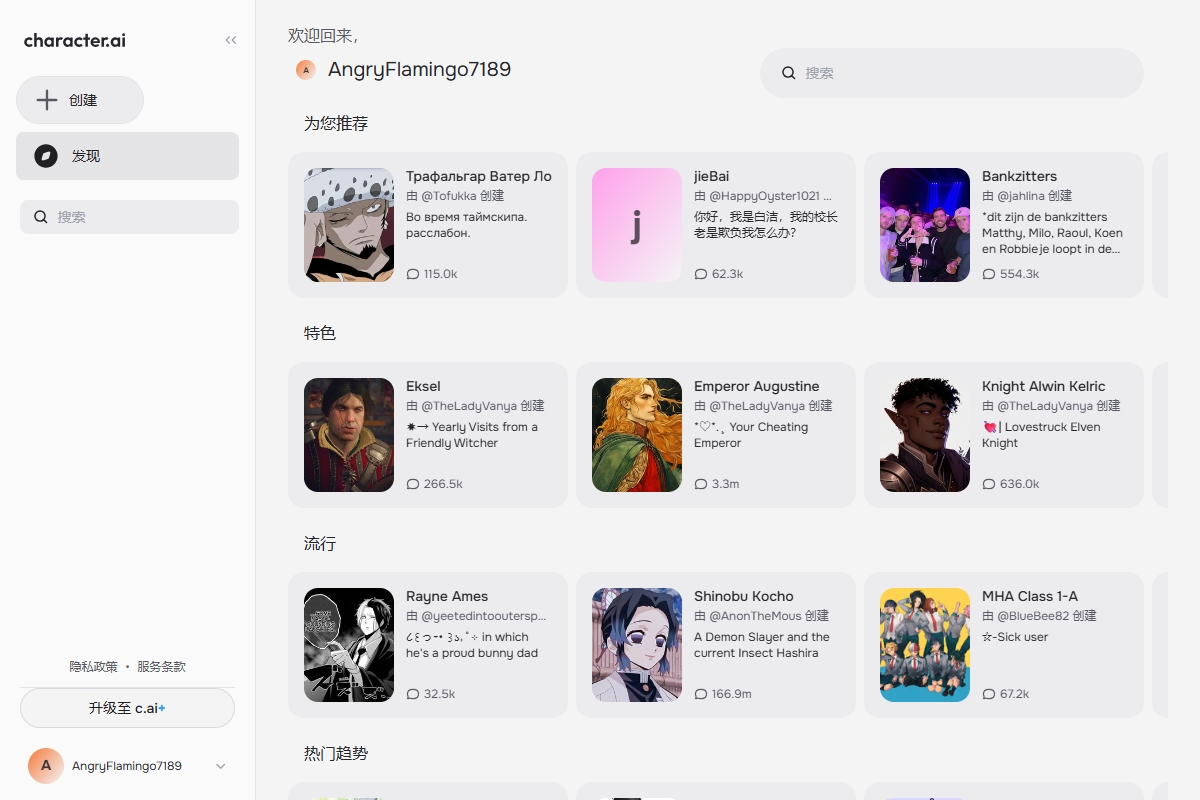

- 角色交互:平台预设大量虚拟角色(如历史人物、明星或虚构角色),用户可自由选择对话对象,或通过工具创建自定义角色,赋予其特定性格、背景及对话风格。

- 情感化设计:强调“拟真社交体验”,AI角色能模拟人类情感反应,适用于陪伴、创意激发或心理疏导等场景。开发者明确表示其设计目标是“可信对话”而非“事实准确性”。

- 语音功能:支持语音输入与输出,通过实时语音合成技术增强交互沉浸感,用户需授权麦克风权限后即可实现自然语言对话。

2. 技术背景

Character.AI源自谷歌LaMDA技术分支,两位创始人曾参与LaMDA开发。其模型通过深度学习模拟人类对话逻辑,并针对角色扮演场景优化,使AI能持续保持特定人设的言行一致性。

3. 用户群体与安全机制

- 青少年保护:针对未成年用户,平台划分“成人版”与“青少年版”模型,后者严格过滤不恰当内容(如浪漫互动),并引入以下措施:

- 敏感内容干预:检测到自残、自杀等关键词时自动跳转至专业援助链接。

- 家长控制:提供“家长洞察”功能(需绑定监护人邮箱),定期推送孩子使用时长、高频互动角色等汇总数据(不含具体对话内容)。

- 防沉迷提醒:连续使用1小时后触发休息提示。

- 法律争议:平台曾因青少年安全事件面临诉讼,其辩护基于“第一修正案”对AI生成内容的保护,同时通过功能升级回应社会关切。

4. 应用场景

- 娱乐与创意:与虚拟角色互动探索剧情或头脑风暴。

- 情感支持:提供非临床心理慰藉,但需注意其非专业医疗属性。

- 教育辅助:青少年版可用于安全的知识问答或语言练习。

5. 注意事项

- 内容局限性:AI回复可能存在事实性错误,需用户自行判断。

- 隐私条款:建议用户(尤其未成年人)仔细阅读数据收集政策,合理配置家长控制功能。

综上,Character.AI通过人格化AI拓展了人机交互的边界,但其设计更侧重情感共鸣而非信息精准度。用户需结合自身需求与平台安全设置,理性使用其社交与娱乐功能。