kaggle.com

Kaggle是全球最大的数据科学与机器学习在线社区平台,由Kaggle Inc.运营(2010年创办,后被Google收购),旨在为数据从业者提供协作、竞赛及资源整合的一站式服务。

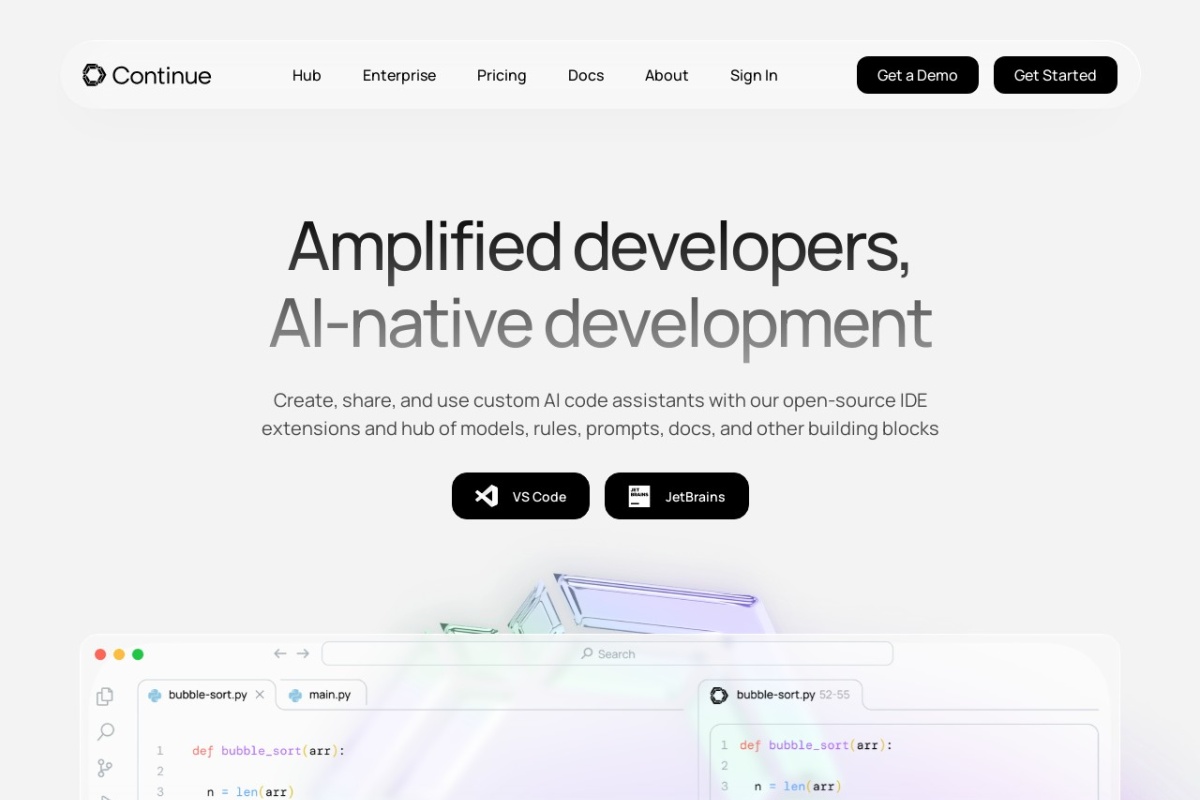

Continue 是一个开源的、可在本地或私有云运行的 AI 编程助手(副驾驶),它深度集成到 VS Code 和 JetBrains IDE 中,旨在提升开发者在编写、理解、重构和调试代码时的效率和体验。

全面解读:

核心定位与目标用户:

核心功能:

/命令): 提供快捷命令执行特定任务(如 /test, /edit)。关键特色与优势:

Open Source): 代码完全开放(GitHub 仓库),透明可信,社区可参与贡献和改进。Run Locally):

Customizable):

config.json)来选择模型、设置上下文规则、添加快捷命令等。技术栈与架构:

与 Copilot 等产品的对比:

使用场景:

总结:

Continue 是一个将开发者隐私、模型选择自由度和开源精神放在首位的 AI 编程助手。它通过在本地或私有环境运行,深度集成到主流 IDE 中,并支持连接各种云端和本地 AI 模型,为开发者提供了一个强大、安全且可定制的“副驾驶”体验。它非常适合重视代码安全、希望避免供应商锁定、或需要在离线环境下使用 AI 辅助的开发者。用户可以通过其官网获取安装指南、文档,并参与其活跃的开源社区。