CAVEDUCK

CAVEDUCK是一个专注于实时AI角色互动的平台,支持用户与预设或自定义的AI角色进行动态交流,提供拟人化交互体验。

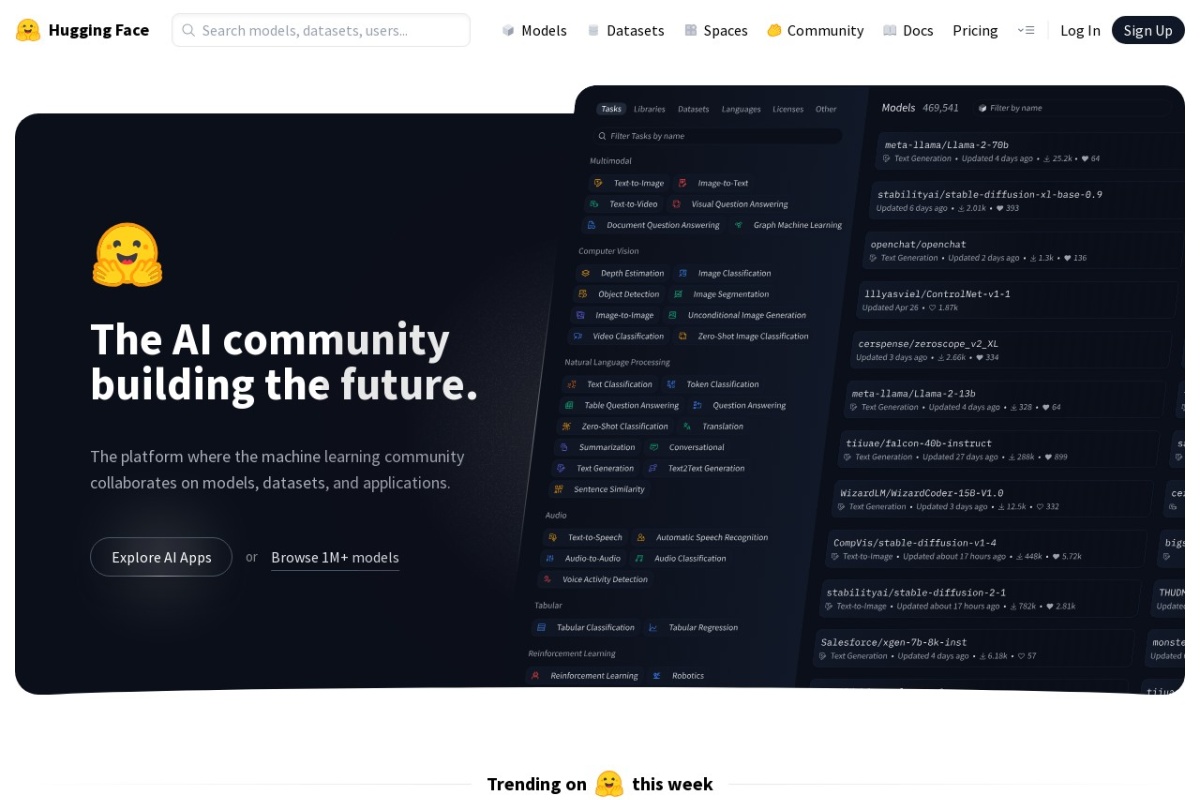

Hugging Face( https://www.huggingface.co )是一个以自然语言处理(NLP)为核心的人工智能开源社区和平台,致力于推动机器学习技术的民主化与协作创新。以下从多个维度对其核心功能与生态进行系统解析:

transformers:模型加载与训练的核心库。

datasets:高效数据处理。

tokenizers:高性能文本分词。

diffusers:扩散模型(如Stable Diffusion)支持。

accelerate:简化分布式训练。

pip install transformers datasets huggingface_hub

pipeline()函数实现零代码推理。

Hugging Face通过构建工具、数据、模型三位一体的生态系统,彻底改变了AI开发范式。其核心优势在于开源协作、易用性及前沿技术的快速集成,适合研究者、工程师及爱好者探索最先进的AI解决方案。对于中文用户,建议结合镜像站与工具加速访问以提升体验。